工作環境

本身使用win10的作業系統,利用spyder編寫,程式語言為python3.8

分類

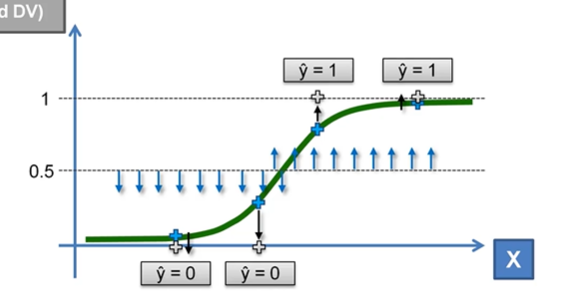

分類算法通常被運用於預測非線性(連續)的資料各自屬於的類別,其中又包含線性模型(邏輯回歸,SVM)和非線性模型(kernal SVM, random forest)來因應各種不同的情況.今天先介紹第一種分類算法:邏輯回歸

大綱:利用二分法來熟悉這個公式,言簡意賅來說就是,先將數據分成兩區,並在中間設立分界線,再依據數據所在的位置進行分類

{從數據庫中導入所需工具}

import numpy as np (解析資料)

import matplotlib.pyplot as plt (圖表呈現)

import pandas as pd (計算工具)

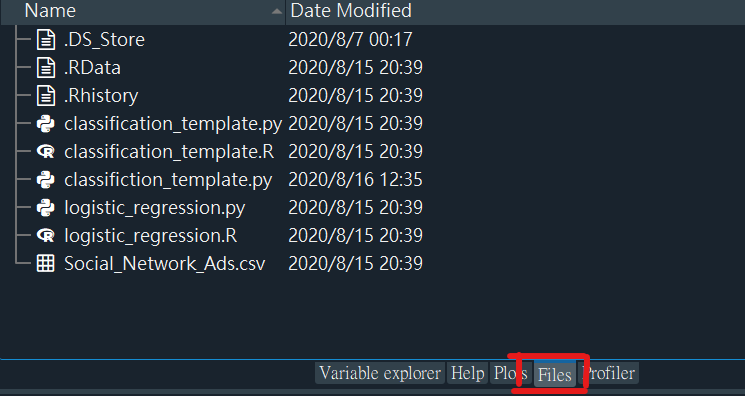

{設置工作路徑}

<右側的files,連結到檔案所屬的路徑>

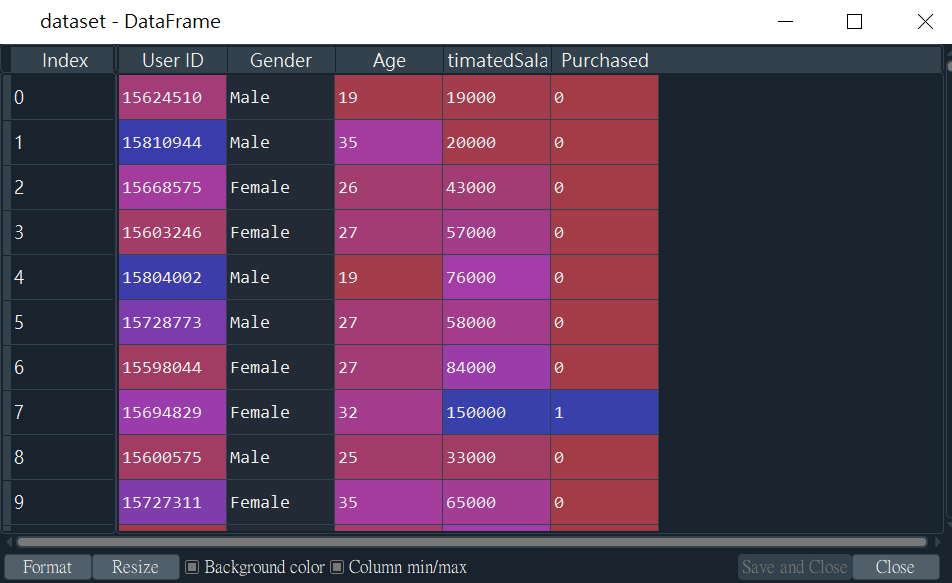

{導入所需數據}

dataset = pd.read_csv('Social_Network_Ads.csv')

X = dataset.iloc[:, [2,3]].values

y = dataset.iloc[:, 4].values

{將資料分成訓練集以及測試集}

<test_size為測試集所占比重,一半為8:2>

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0)

{特徵縮放}

<當資料需要找出關聯,但數據差過大時,利用特徵縮放讓數據呈現在同水平>

from sklearn.preprocessing import StandardScaler

sc_X = StandardScaler()

X_train = sc_X.fit_transform(X_train)

X_test = sc_X.transform(X_test)

{利用訓練集讓機器開始學習}

from sklearn.linear_model import LogisticRegression

classifier = LogisticRegression(random_state = 0)

classifier.fit(X_train, y_train)

{利用擬和器開始預測}

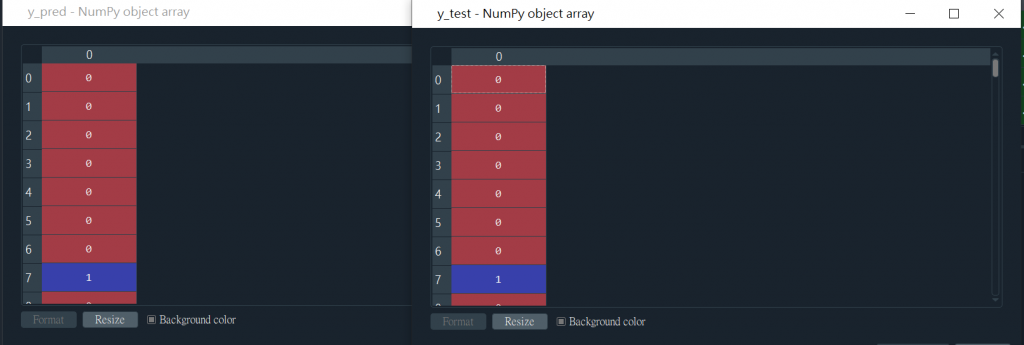

y_pred = classifier.predict(X_test)

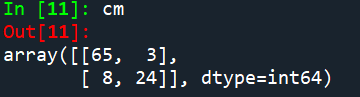

{利用混淆矩陣檢測錯誤樣本數}

from sklearn.metrics import confusion_matrix

cm = confusion_matrix(y_test, y_pred)

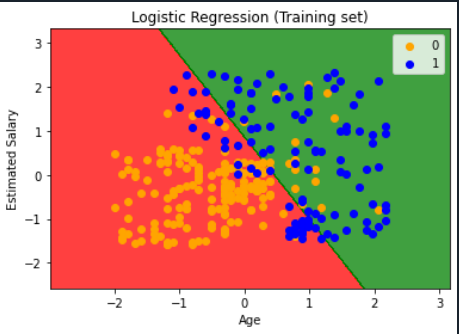

{將結果以圖表成呈現}(訓練集)

from matplotlib.colors import ListedColormap

X_set, y_set = X_train, y_train

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('orange', 'blue'))(i), label = j)

plt.title('Logistic Regression (Training set)')

plt.xlabel('Age')

plt.ylabel('Estimated Salary')

plt.legend()

plt.show()

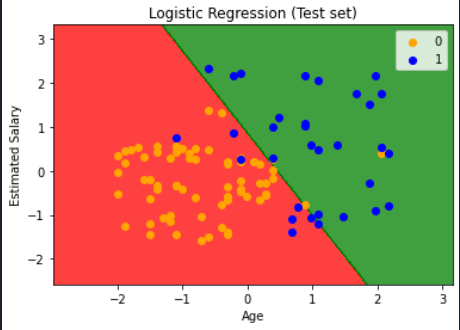

{將結果以圖表成呈現}(測試集)

from matplotlib.colors import ListedColormap

X_set, y_set = X_test, y_test

X1, X2 = np.meshgrid(np.arange(start = X_set[:, 0].min() - 1, stop = X_set[:, 0].max() + 1, step = 0.01),

np.arange(start = X_set[:, 1].min() - 1, stop = X_set[:, 1].max() + 1, step = 0.01))

plt.contourf(X1, X2, classifier.predict(np.array([X1.ravel(), X2.ravel()]).T).reshape(X1.shape),

alpha = 0.75, cmap = ListedColormap(('red', 'green')))

plt.xlim(X1.min(), X1.max())

plt.ylim(X2.min(), X2.max())

for i, j in enumerate(np.unique(y_set)):

plt.scatter(X_set[y_set == j, 0], X_set[y_set == j, 1],

c = ListedColormap(('orange', 'blue'))(i), label = j)

plt.title('Logistic Regression (Test set)')

plt.xlabel('Age')

plt.ylabel('Estimated Salary')

plt.legend()

plt.show()